KI-VO: Wie funktioniert die Risikoeinstufung von KI-Systemen?

Die KI-VO verfolgt einen risikobasierten Ansatz. Zentral für diesen Ansatz ist die Einstufung der KI-Systeme bzw. der Anwendungszwecke in eine von vier Risikostufen: Inakzeptables Risiko, Hohes Risiko, Begrenztes Risiko und Minimales Risiko.

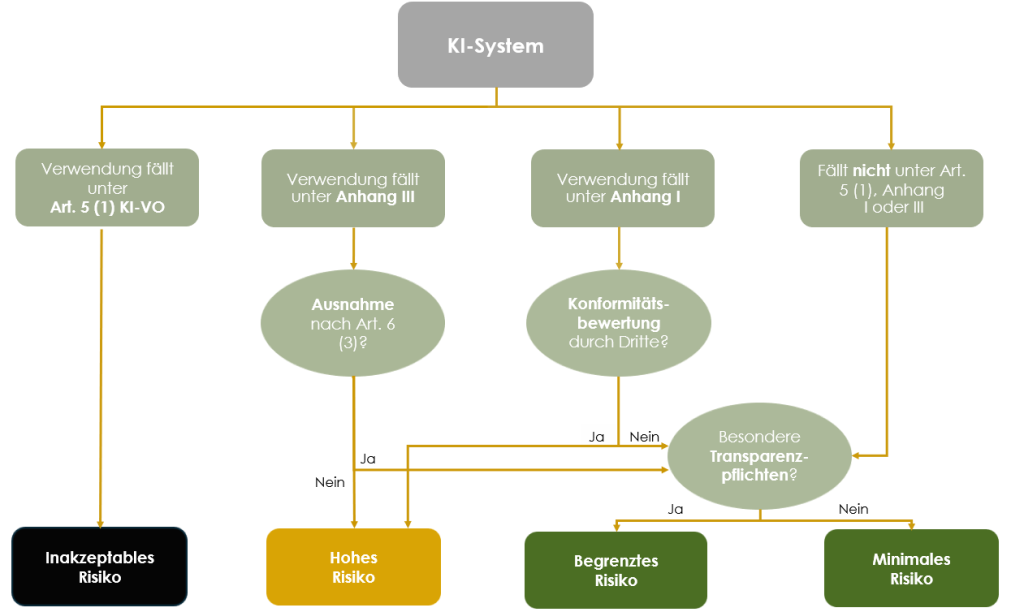

Die Einstufung eines KI-System erfolgt nach folgendem Schema:

Bei der Einstufung kann sowohl die Eigenschaft des KI-Systems selbst, der Verwendungszweck oder der Einsatzbereich ausschlaggebend für die Risikoeinstufung ein.

.

Inakzeptables Risiko

Wenn ein KI-System oder Verwendungszweck in Art. 5 Abs. 1 KI-VO aufgeführt wird und somit unter die verbotenen Praktiken fällt, darf das KI-System nicht (bzw. nicht zu diesem Zweck) in Verkehr gebracht oder eingesetzt werden.

Art. 5 Abs. 1 KI-VO verbietet in erster Linie Praktiken bzw. Verwendungszwecke, und keine Systeme. Ein KI-System, welches Fähigkeiten im Sinne von Art. 5 Abs. 1 KI-VO aufweist, kann unter bestimmten Bedingungen rechtskonform eingesetzt werden. So sind KI-Systeme zum Ableiten von Emotionen nicht prinzipiell verboten, sondern nur deren Einsatz am Arbeitsplatz oder an Bildungseinrichtungen und nur sofern bestimmten Bedingungen vorliegen. Gleichzeitig zeichnen sich viele KI-Systeme dadurch aus, dass sie vielseitig verwendbar sind. KI-Systeme, die für die in Art. 5 Abs. 1 KI-VO genannten Praktiken eingesetzt werden könnten, aber zu anderen Zwecken verwendet werden, fallen ebenso nicht unter das Verbot. Selbst die von der KI-VO als besonders riskant bewerteten Systeme, „mit denen natürliche Personen individuell auf der Grundlage ihrer biometrischen Daten kategorisiert werden, um ihre Rasse, ihre politischen Einstellungen, ihre Gewerkschaftszugehörigkeit, ihre religiösen oder weltanschaulichen Überzeugungen, ihr Sexualleben oder ihre sexuelle Ausrichtung zu erschließen oder abzuleiten“, dürfen unter sehr engen Voraussetzungen eingesetzt werden.

Hohes Risiko aufgrund des Einsatzbereichs

Anhang III führt verschiedene Bereiche auf, in denen der Gesetzgeber den Einsatz von KI als besonders risikobehaftet einschätzt. Soll ein System in einem der in Anhang III aufgeführten Bereich eingesetzt werden, gilt es nach Art. 6 Abs. 2 KI-VO als Hochrisiko-KI-System.

Bereiche mit besonderer Relevanz für privatwirtschaftliche Organisationen sind beispielsweise das Personalwesen, der Bildungsbereich, bestimmte Anwendungszwecke der Biometrie und der Bereich Kritische Infrastruktur. Nach Art. 6 Abs. 3 KI-VO kann die Hochrisikoeinstufung eines in den genannten Bereichen eingesetzten KI-Systems unterbleiben, wenn bestimmte risikomindernde Bedingungen vorliegen: Nämlich, wenn vom KI-System lediglich eng gefasste Verfahrensaufgaben übernommen, eine menschliche Tätigkeit lediglich verbessert, nicht Entscheidungen, sondern nur deren Evaluationen vorgenommen oder lediglich vorbereitende Aufgaben in den genannten Bereichen an das KI-System delegiert werden.

Eine Rückausnahme wurde vom Gesetzgeber übrigens aber für alle Aspekte des Profiling eingefügt.

Hohes Risiko aufgrund der Produkteigenschaft

Die zweite Option, die zu einer Einstufung als Hochrisiko-KI-System führt, stellt sich etwas komplexer dar. Diese bezieht sich auf KI-Systeme, die entweder selbst ein Produkt sind oder welche als Sicherheitsbauteil eines Produkts fungieren.

Im ersten Schritt muss geprüft werden, ob das KI-System als Produkt unter eine von zahlreichen, in Anhang I aufgeführten Harmonisierungsrechtsvorschriften fällt. Zu diesen Vorschriften gehören z. B. Richtlinie 2014/90/EU über Schiffsausrüstung, Richtlinie 2014/34/EU über Schutzsysteme zur bestimmungsgemäßen Verwendung in explosionsgefährdeten Bereichen oder Verordnung (EU) 2017/745 über Medizinprodukte.

Im zweiten Schritt ist zu prüfen, ob dieses Produkt auf der Grundlage dieser Harmonisierungsrechtsvorschriften einer obligatorischen Konformitätsbewertung durch Dritte unterliegt.

Bei einem KI-System, welches z. B. als Medizinprodukt vertrieben werden soll, müsste der Hersteller somit zunächst eine Einstufung des Systems nach der Medizinprodukteverordnung vornehmen. Wenn diese Einstufung bedeutet, dass das Medizinprodukt eine Konformitätsbewertungsverfahren durch die „Zentralstelle der Länder für Gesundheitsschutz bei Arzneimitteln und Medizinprodukten“ durchlaufen muss, dann gilt dieses Produkt (oder das Sicherheitsbauteil) als ein KI-System mit Hohem Risiko.

Begrenztes und Minimales Risiko

Wenn das KI-System aufgrund der Produkteigenschaften, seines Einsatzbereiches oder seines Verwendungszwecks weder unter Art. 5 Abs. 1 KI-VO noch unter Anhang I oder III fällt, liegt ein „Begrenztes Risiko“ oder „Minimales Risiko“ vor.

Diese Terminologie wird in der KI-VO allerdings nicht unmittelbar verwendet und dementsprechend wird die Unterscheidung dort auch nicht operationalisiert. Vielmehr begründen begleitende Hinweise der EU-Kommission diese Systematik. Die EU-Kommission legt fest, dass KI-Systeme, die keine Hochrisiko-KI-Systeme sind, deren Verwendung bei unzureichender Transparenz aber mit Risiken für die Betroffenen verbunden sind, als Systeme mit Begrenztem Risiko einzustufen sind. So muss bspw. der Betreiber eines Chatbot die Nutzer darüber in Kenntnis setzen, dass sie mit einer Künstlichen Intelligenz interagieren und betreibt somit ein KI-System mit Begrenztem Risiko. Alle anderen KI-Systeme gelten dann als KI-Systeme mit Minimalem Risiko.

Änderungen

Der rasanten Entwicklung der KI-Technologie steht eine schwerfällige europäische Gesetzgebung gegenüber. Daher hat der Gesetzgeber der EU-Kommission die Befugnis eingeräumt, den Anhang III, der risikobehaftete Einsatzbereiche aufführt, anzupassen. Folgende Kriterien müssen dabei nach Art. 7 Abs. 2 KI-VO von der EU-Kommission für etwaige Anpassungen berücksichtigt werden:

- Zweckbestimmung

- Umfang des Einsatzes

- Art und Umfang der verwendeten Daten

- Autonomie des Systems

- Risikogeschichte (bekannte Vorfälle)

- Ausmaß eines möglichen Schadens

- Abhängigkeit der Betroffenen von dem System (kein Opt-out)

- Machtungleichgewicht zwischen Betreiber und Betroffenen sowie Auswirkung auf schutzbedürftige Personen

- Wahrscheinlichkeit und Ausmaß des möglichen Nutzens

- Risikomitigierung durch bestehende EU-Gesetze

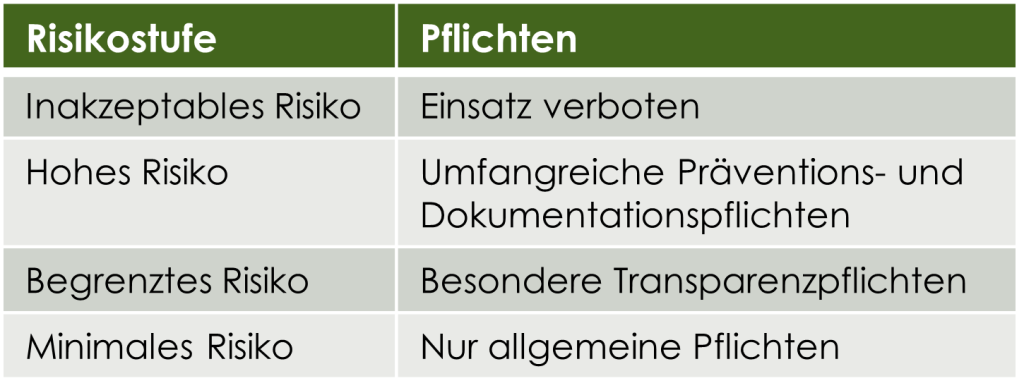

Pflichten

Die Risikoeinstufung eines KI-Systems bringt jeweils eigene Auflagen und Pflichten mit sich.

Die besonderen Pflichten für Betreiber und Anbieter von Hochrisikosystemen haben wir bereits in unserem letzten Post beleuchtet.

.

Sie wollen ihre KI-Systeme der richtigen Risikostufe zuordnen? Oder Sie wollen nach einer solchen Einstufung die notwendigen Compliance-Maßnahmen ergreifen? Sprechen Sie uns gerne an.

Um zum Thema KI-VO auf dem Laufenden zu bleibend, abonnieren Sie einfach unseren Newsletter.

Konkrete Hinweise zum Vorgehen bei der Risikoeinstufung nach KI-VO erhalten Sie auch in unserem Webinar am 3. Dezember 2024. Hier geht es zur Anmeldung.